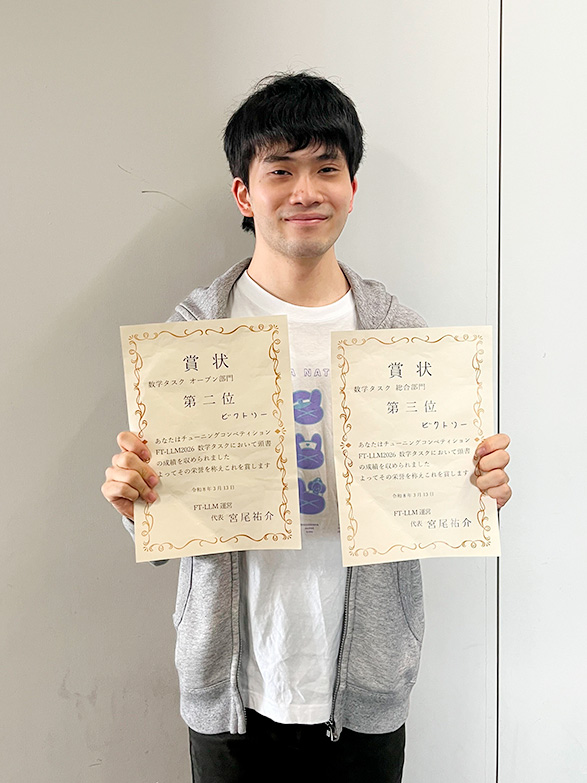

嶋中雄大さんが言語処理学会第32回年次大会(NLP2026)にて数学タスク総合部門 3位およびオープン部門 2位に入賞

2026/04/16

- 情報工学科

受賞者

嶋中 雄大さん(情報工学科)

指導教員

菅谷 みどり教授(工学部)

学会・大会名

言語処理学会第32回年次大会(NLP2026)

賞名

数学タスク 総合部門 3位 オープン部門 2位

第2回大規模言語モデルのファインチューニング技術と評価(FT-LLM 2026)コンペティション

研究内容

言語処理学会第32回年次大会(NLP2026)の併設ワークショップとして、国立情報学研究所(NII)が主催した「FT-LLM 2026」に、複数大学の学生による混成チームで参加しました。日本語大規模言語モデル(llm-jp-4)を基盤として、中学・高校数学の数理推論に特化したモデル学習と推論システムを構築しました。約900万件の合成データ生成、OpT-DeUSによる層拡張(8B→12B)、教師ありファインチューニング(SFT)、強化学習の一手法(GRPO)、Self-Consistency(多数決推論)を組み合わせた手法により、オープン部門2位、総合部門3位を受賞しました。

研究目的

日本語で数学を解ける高精度なAIシステムの構築を目的としました。既存の数学データセットは英語中心で、日本語のものはほとんど存在しなかったため、Apache 2.0ライセンスのオープンソースソフトウェア(OSS)モデルのみを用いて、思考過程を含む解答形式(CoT)付き学習データ約900万件をゼロから自動生成しました。さらに、教師ありファインチューニング(SFT)と強化学習の一手法(GRPO)を組み合わせた、一貫した学習パイプラインを設計し、限られた計算資源の中でも高精度な数理推論を実現することを目指しました。

今後の展望

本研究で得られたパイプライン設計の知見は、数学に限らず、科学技術計算や論理的な文書解析など、正確な多段推論が求められる幅広い分野への展開が期待されます。特に、日本語に特化した高性能な推論モデルの開発は、国内の教育支援ツールや研究補助システムとしての社会実装に直結するものであり、今後も継続的に研究・開発を進めていきます。